テスラが「AIデー」で解説した“テスラ・ビジョン”は先端技術「トランスフォーマー」でデジタルの限界を突破

テスラでは自動運転にあたって、センサーではなく画像認識によって空間を把握するしくみを採用している。そこで注目されるのが、このしくみを実現させている人工知能(AI)の能力だ。レベルの高い自動運転を現実のものとしていくためには、まだまだAIが進化していく必要があるだろう。こうした背景から、2021年8月19日、テスラはリクルーティング・イベントを兼ねたAIの技術説明会「AIデー」を開催した。そこではどのような発表があったのか、日本サスティナブル・エナジー代表取締役の大野嘉久氏が解説する。

カメラだけの自動運転を実現した世界最高のAI技術「テスラ・ビジョン」

米電気自動車大手テスラが2021年8月19日に開催した人工知能(AI)技術を発表する説明会「AIデー」では人型ロボット「テスラ・ボット」に注目が集まっているが、同社は今回を史上最大規模のリクルーティング・イベントと位置づけており、世界中から優秀なエンジニアを集めることを目的として幹部たちが最新のAI技術を解説した。

なぜテスラ以外の全ての会社(Google/ウェイモ陣営)が車に高価な最新センサー類を満載し、そのうえ完成に膨大な費用のかかる高精度な地図を前提としたシステムを構築したかというと、それでしか安全が保たれないと考えていたからである。しかしコストが高すぎて進展していないのが現状となっている。

画像の認識は2次元なら現在でもかなり進んでいて、例えば "Google検索" に新幹線の写真をアップロードすると、それが新幹線であることだけでなく車両形式まで正確に解析して教えてくれる。しかしカメラ映像だけの自動運転を実現するためには自らが速いスピードで動きながら、且つ信号やビルなどの動いていないモノだけでなく、車や人、動物など動いているモノのデータも正確に把握しないといけないが、これが極めて困難なのである。

人間であれば、「あの走っている白い小動物は犬かと思ったが、よく見たら実は猫だった」などという曖昧さを許容することも可能だが、コンピューターは動画をコマ割りした静止画をもとに解析するため、正しく判断できているコマと、動物の角度や姿勢によってはどうしても判断がつかないコマが出てきてしまう。

あるいは、途中で車や人や電柱などにさえぎられて、やはり判断のつかないコマも出てくることがあるため、「犬→犬→?→?→?→猫→猫→?→?……」という判定になってしまう。さらに、人間の目が鼻の両側という近い場所に置かれているのに対し、テスラ車なら前方だけでなく横や後方など合計8個の車載カメラをつけているので、左右や背後の情報量は人間よりはるか多いが、それらすべてのデータをリアルタイムで一つに統合することが技術的に困難となる。

テスラが最新のセンサー機器との併用をやめてカメラだけにしたのも、多種類のセンサーを使うことによる情報の不一致を避けるため、というのが最も大きな理由の一つであった。

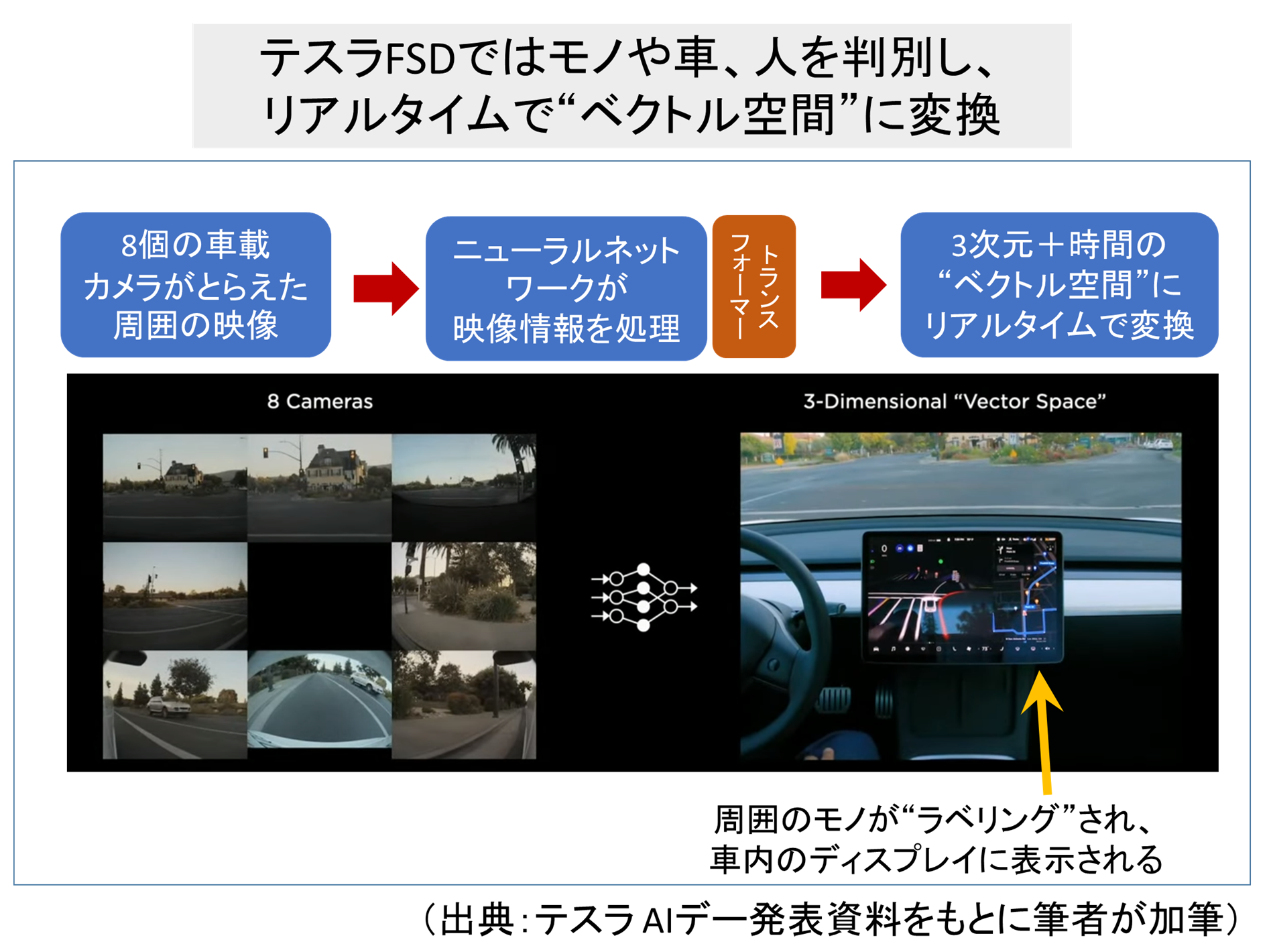

そのうえテスラの最新版FSD(Full Self Driving/完全自動運転)ベータだと1秒に36回という超高速で画像が処理されるため、機器には全く問題がないのに情報の統合に支障が出てきてしまう恐れもある。そこでテスラは4年前に独自開発した「トランスフォーマー」を使い、複数台のカメラに映った情報に整合性を出せるよう適切にデータを修正して、3次元+時間のベクトル空間を作り上げることに成功した。

現実の情報をデジタル化した「ベクトル空間」

AI担当シニア・ディレクターで、「ビジョン・システム」を作り上げたアンドレ・カパーティー氏(Dr. Andrej Karpathy)の説明によると、テスラ車に設置された8個のカメラでとらえられた映像は「ベクトル空間」に落とし込まれ、それぞれの位置や進んでいる角度、速度などが把握される。

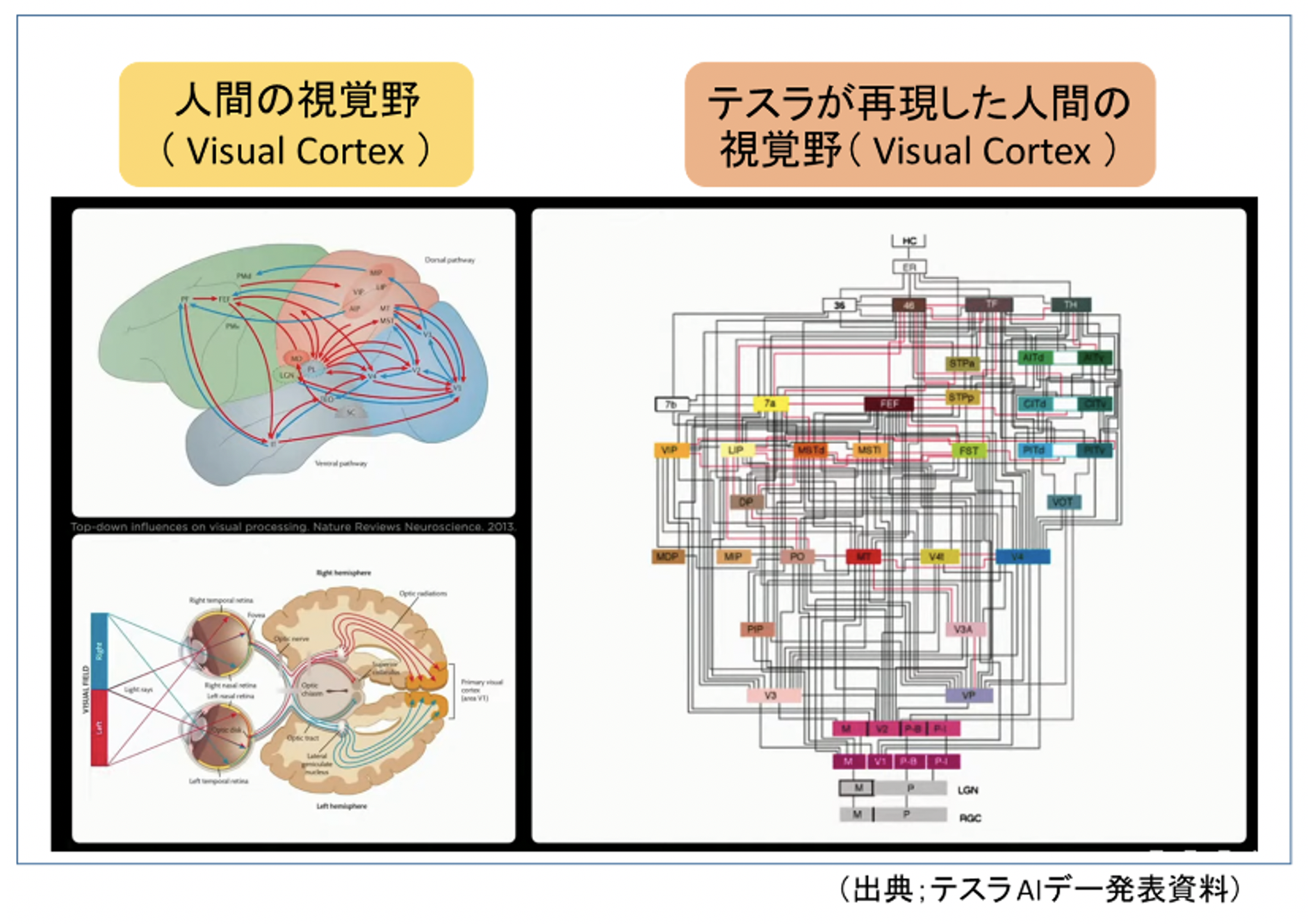

たとえば「物体82M6459DGは時速**kmで**から**に向かって歩いている“人”」「物体726184ZQは時速**kmで**から**に向かって走っている“車”」のようにそれぞれベクトルとしてとらえ、リアルタイムで再現している。これらはコンピューター工学の新しいパラダイムと呼ばれる「アーティフィシャル・ニューロン・ネットワーク(Artificial Nuro network/人工神経網)によって人間の視覚野がコンピューター上に構築される。

最先端のシミュレーション

AIは既に学習していることなら場合によっては人間よりも速く正しく判断できるが、ただし知らないことはできない、という性質がある。

それをカバーするためにテスラはシミュレーション技術を高めて、自動運転システムが事故を起こす可能性を限界まで減らそうとしており、その新しいバージョンではカメラで撮影した映像にしか見えないレベルのシミュレーションが可能となっている。

下図はテスラがAIデーで発表したものだが、なんとまだ発売されていないピックアップトラックの「サイバートラック」が登場している。

テスラの最新シミュレーション

テスラには路上を走っているテスラ車から送信された多くの映像データが大量にストックされており、こうしたシミュレーションに使われている。なおテスラがシミュレーションを使うのはあくまでも交通事故をなくすためのシステムのトレーニングであり、実際に車を動かす指示はその場で得た情報をもとに出されるようである。

また、路上を走るテスラ車から送信されたデータは本社で解析されてFSDソフトウエアに反映され、それが路上を走るテスラ車に送られて最新版にアップデートされる、という仕組みになっている。

この日、AIデーでプレゼンテーションに立った幹部は様々な国のエンジニアたちであった。願わくば、1人でも日本人が今回のリクルーティング・イベントを契機としてテスラに入社し、こうして幹部エンジニアとして発表の場に立ってもらいたい。

*EnergyShiftの「テスラ」関連記事はこちら

モビリティの最新記事